Anthropic ha actualizado la documentación de sus rastreadores web para ofrecer un desglose detallado de sus tres bots actuales. Esta decisión marca un cambio en la forma en que los propietarios de sitios web deben gestionar el acceso de la inteligencia artificial a sus contenidos. Hasta ahora, la identificación de Claude era más genérica, pero la nueva estructura permite un control granular sobre el entrenamiento, las consultas de los usuarios y la indexación para búsquedas.

Los tres nuevos rastreadores de Anthropic

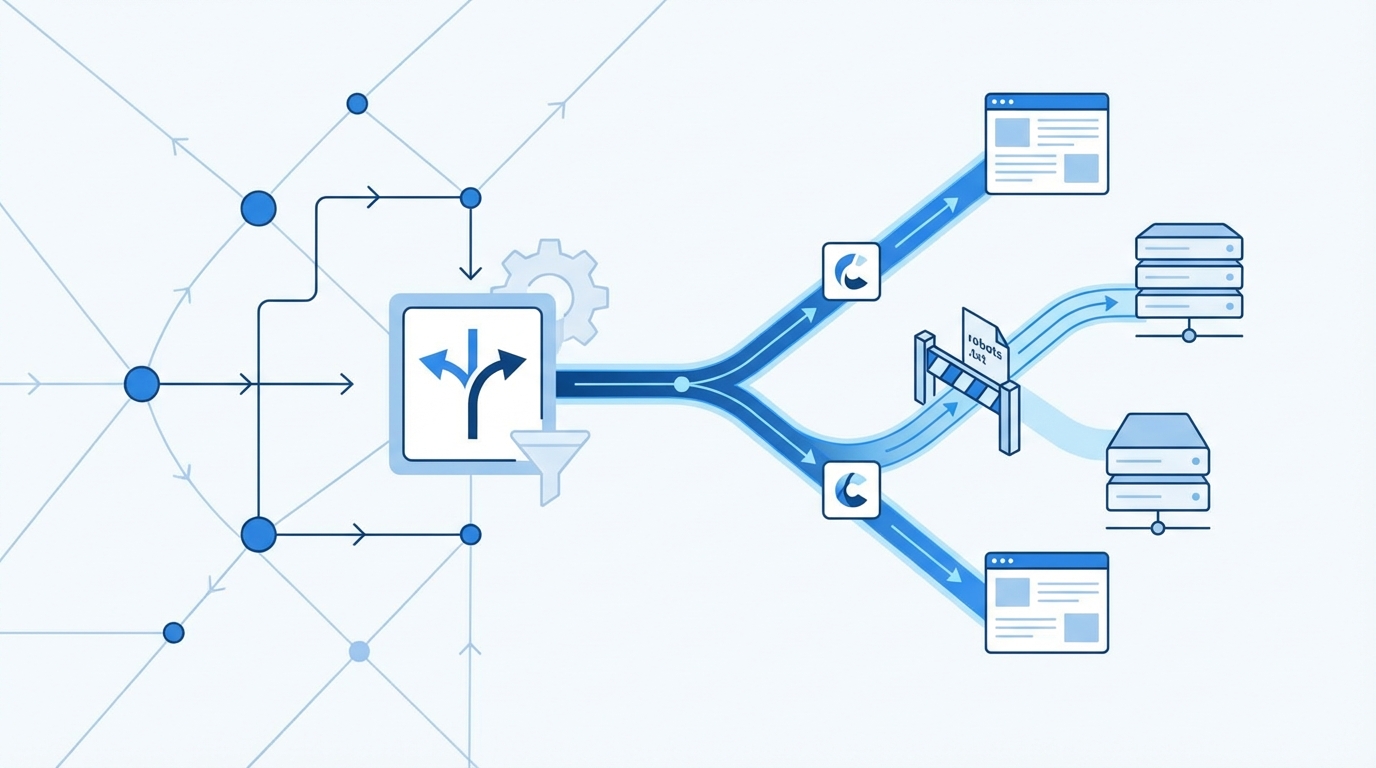

La compañía ha definido tres user-agents específicos, cada uno con una función diferenciada dentro del ecosistema de Claude. Comprender qué hace cada uno es fundamental para decidir qué permisos otorgar en vuestro archivo robots.txt.

- ClaudeBot: Se dedica exclusivamente a la recopilación de datos para el entrenamiento de modelos de lenguaje. Es el rastreador que alimenta la base de conocimientos general de la IA.

- Claude-User: Este bot se activa cuando un usuario de Claude solicita específicamente que la IA visite una página web para responder a una pregunta en tiempo real.

- Claude-SearchBot: Su función es indexar contenido para los resultados de búsqueda dentro de Claude. Es el equivalente al Googlebot para el motor de búsqueda de Anthropic.

Consecuencias de bloquear cada bot

Anthropic ha sido clara sobre lo que sucede al deshabilitar estos rastreadores. Bloquear Claude-SearchBot impide que el sistema indexe vuestro contenido para la optimización de búsquedas. Esto se traduce en una reducción directa de la visibilidad y de la precisión de vuestra web en las respuestas que Claude ofrece a sus usuarios. En la práctica, si vuestra web no está en su índice de búsqueda, dejáis de existir para quienes usan Claude como herramienta de consulta.

Respecto a Claude-User, el bloqueo evita que el sistema recupere contenido ante una consulta directa de un usuario. Si un usuario introduce una URL vuestra para que Claude la analice o resuma, el bot no podrá acceder si lo tenéis restringido. Esta fragmentación de funciones sigue la estela de otros gigantes del sector, como ya vimos al analizar el panel de IA en Bing y nuevos límites de Googlebot.

Una tendencia imparable en los buscadores de IA

La maniobra de Anthropic no es aislada. Refleja un patrón estándar que ya aplican OpenAI y Perplexity. OpenAI opera con una estructura de tres niveles similar: GPTBot para entrenamiento, OAI-SearchBot para búsquedas y ChatGPT-User para peticiones directas. Por su parte, Perplexity utiliza PerplexityBot para indexar y Perplexity-User para la recuperación de datos.

Existe una diferencia técnica relevante en cómo interpretan estas empresas las instrucciones del robots.txt. Anthropic afirma que sus tres bots respetan las directrices del archivo, incluido Claude-User. Sin embargo, competidores como OpenAI advierten que las reglas del robots.txt podrían no aplicarse de la misma forma a los rastreadores iniciados por el usuario, ya que se consideran acciones directas del cliente y no rastreos automáticos masivos.

El fin del bloqueo masivo a la IA

La estrategia de bloquear todos los rastreadores de IA por defecto, muy común durante 2024, ha dejado de ser eficiente. Si bloqueáis ClaudeBot, detenéis el entrenamiento con vuestros datos, pero eso no afecta a Claude-SearchBot ni a Claude-User. Para desaparecer totalmente de Claude, tendríais que listar y bloquear cada uno de los agentes por separado.

Muchos medios de comunicación están cambiando su enfoque. Según datos recientes del sector, mientras que el bloqueo a los bots de entrenamiento sigue siendo alto, la permisividad hacia los bots de búsqueda está creciendo. Los editores entienden que aparecer en las fuentes citadas por la IA es una nueva vía de tráfico. Para mejorar vuestra presencia en estos entornos, podéis consultar estas estrategias para aparecer en las citas de ChatGPT, que son aplicables en gran medida a Claude.

Cómo auditar vuestro robots.txt para Claude

Debéis revisar vuestro archivo de configuración para aseguraros de que no estáis perdiendo tráfico de forma involuntaria. No basta con una directiva genérica. Una configuración estratégica requiere entradas separadas.

Si queréis proteger vuestra propiedad intelectual pero seguir apareciendo como fuente fiable en las respuestas de Claude, podríais permitir el acceso a Claude-SearchBot mientras denegáis el paso a ClaudeBot. Esta distinción es vital para mantener la autoridad temática mediante el interlinking y el contenido de calidad, asegurando que los modelos de respuesta os sigan considerando una referencia en vuestro sector.

Para implementar correctamente estas configuraciones técnicas y asegurar que vuestra web no pierde tráfico orgánico ante estos cambios, contar con un consultor SEO experimentado permite tomar decisiones basadas en datos y no en suposiciones. La configuración del robots.txt se ha vuelto una tarea de precisión que impacta directamente en el negocio.

El impacto a largo plazo en el tráfico web

La separación de estos rastreadores crea una nueva categoría de decisiones para los responsables de marketing digital. Es muy parecido a lo que Google hizo con Google-Extended, permitiendo a los sitios salir del entrenamiento de Gemini sin desaparecer de los resultados de búsqueda tradicionales. Ahora, Anthropic ofrece esa misma capacidad de elección.

A medida que las búsquedas impulsadas por IA ganan cuota de mercado, el coste de oportunidad de bloquear los rastreadores de búsqueda aumenta. Los datos indican que el volumen de rastreo de los bots de búsqueda de IA está superando al de los bots de entrenamiento en muchos segmentos. Los editores que sepan navegar esta estructura de tres niveles estarán mejor posicionados para captar el tráfico del futuro, donde la respuesta directa y la cita de fuentes son los pilares fundamentales.

En conclusión, revisad vuestros logs de servidor, identificad qué bots de Anthropic os están visitando y ajustad vuestro robots.txt para alinearlo con vuestros objetivos de visibilidad y protección de datos. La granularidad es vuestra mejor herramienta en este nuevo escenario del SEO técnico.

¿Necesitas mejorar el posicionamiento de tu web?

Si quieres aplicar estas estrategias y obtener resultados reales, puedo ayudarte. Llevo años trabajando el SEO de empresas y proyectos digitales con un enfoque técnico y orientado a resultados.

Solicitar consulta SEOPreguntas frecuentes

¿Qué diferencia hay entre ClaudeBot y Claude-SearchBot?

ClaudeBot se usa exclusivamente para recolectar datos destinados al entrenamiento de los modelos de Anthropic, mientras que Claude-SearchBot indexa contenido para mostrar resultados y fuentes dentro de las funciones de búsqueda de Claude.

¿Debo permitir el acceso a Claude-User en mi robots.txt?

Es recomendable si quieres que Claude pueda analizar tus URLs cuando un usuario se lo pide directamente. Bloquearlo impedirá que la IA lea tu contenido para responder preguntas específicas de sus clientes.

¿Respeta Anthropic las directivas del robots.txt para todos sus bots?

Sí, según la documentación oficial de Anthropic, sus tres rastreadores (ClaudeBot, Claude-User y Claude-SearchBot) respetan las instrucciones estándar del archivo robots.txt de cualquier sitio web.

(1).jpg)